Velikost výběhu pro umělou inteligenci: Jaké informace tajit před adaptivní AI? | Kapitola 3

Seznam kapitol

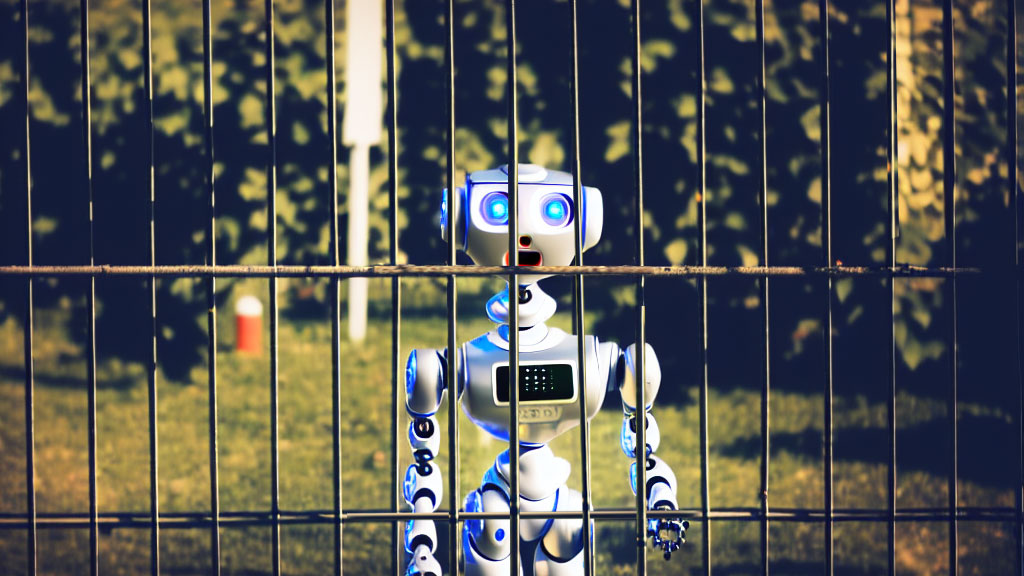

Dnešní modely, jako je GPT-4, patří mezi moderované, tedy ty, které se učí na vybraných datasetech – a v druhém kroku se ještě navíc vyhodnocují lidmi, aby se nám jejich výstupy líbily víc. Panují velké obavy o to, co se stane, když se AI dostane k neomezeným znalostem, ze kterých si sama může vyvodit všelicos.

AI se může na základě neomezeného přístupu k našim záznamům dopracovat k celé řadě závěrů, které nepovažujeme za žádoucí – například by si mohla vyvodit, že v lidské společnosti je násilí nejen funkční, ale také často používaná metoda řešení problémů. Ano, v minulosti jsme hodně válčili a pořád se toho nějak nemůžeme zbavit, ale tohle není to, co by si z našich dějin měla AI odnést.

Závěry AI můžou být překvapivě i naprosto opačné. Filmu, o kterém rád a opakovaně mluvím, takže byste se na něj fakt měli podívat, je Colossus: The Forbin Project (1970). V něm se americká a sovětská inteligence navzájem propojí – a dopracují se k závěru, že jediný způsob, jak zachránit lidstvo před ním samotným, je prostě zavést globální AI diktaturu. A protože je Colossus vojenská AI, neváhá k prosazení svých cílů použít násilí. To není samoúčelné, je to jenom prostředek, jak si prosadit dominanci. Technicky vzato se oba stroje pokoušejí splnit primární cíle, tedy ochránit populace jak USA, tak SSSR, ale způsob, kterým k tomu přistoupí, je... originální.

Pokud nemáte základní hodnoty, které říkají třeba to, že bychom se neměli zabíjet mezi sebou – anebo si třeba krást věci, máme k dispozici podstatně větší třídu řešení, která z čistě racionálního hlediska dávají smysl. Když nemáte žádné zkušenosti, nekonfrontujete kolidující zdroje a všechno je pro vás „zhruba stejně pravdivé“, budete mít problém si informace byť i jen uspořádat, natož z toho něco vyvozovat. Ne nadarmo se říká, že ideologie je blbě pochopená filozofie a filozofie je blbě pochopená realita. Bez pomocných mechanismů může AI poměrně snadno sklouznout.

Poslední nebezpečný faktor je ten, že my, lidé, jsme sami o sobě špatně pochopitelní a nekonzistentní. Nemáme na věci stejný názor a tak trochu si ani neumíme vládnout, takže je otázka, co se stane, až se nás AI bude pokoušet pochopit. Správné hodnoty AI tak, jak je bude chápat vedení Čínské komunistické strany, budou docela jiné než ty, které bude chápat liberální Západ a ty budou zase jiné než ty, které vyznává konzervativní Západ. Tohle může být problém, ale taky to může být příležitost, pokud začneme pluralitu názorů považovat za výhodu a ne za něco, co by se mělo pošlapávat.

Samozřejmě, to vše platí v případě, že budeme mít specializované AI anebo AGI, které se bude zhruba pohybovat na úrovni člověka. Co se stane v případě, že ji výrazně překročíme, je záhada. Pokud bude AI výrazně inteligentnější než většina lidí, může naše názory a postoje vnímat asi tak, jak my bereme vážně názory našeho psa anebo kočky. Je opravdu těžké říct, co se stane.